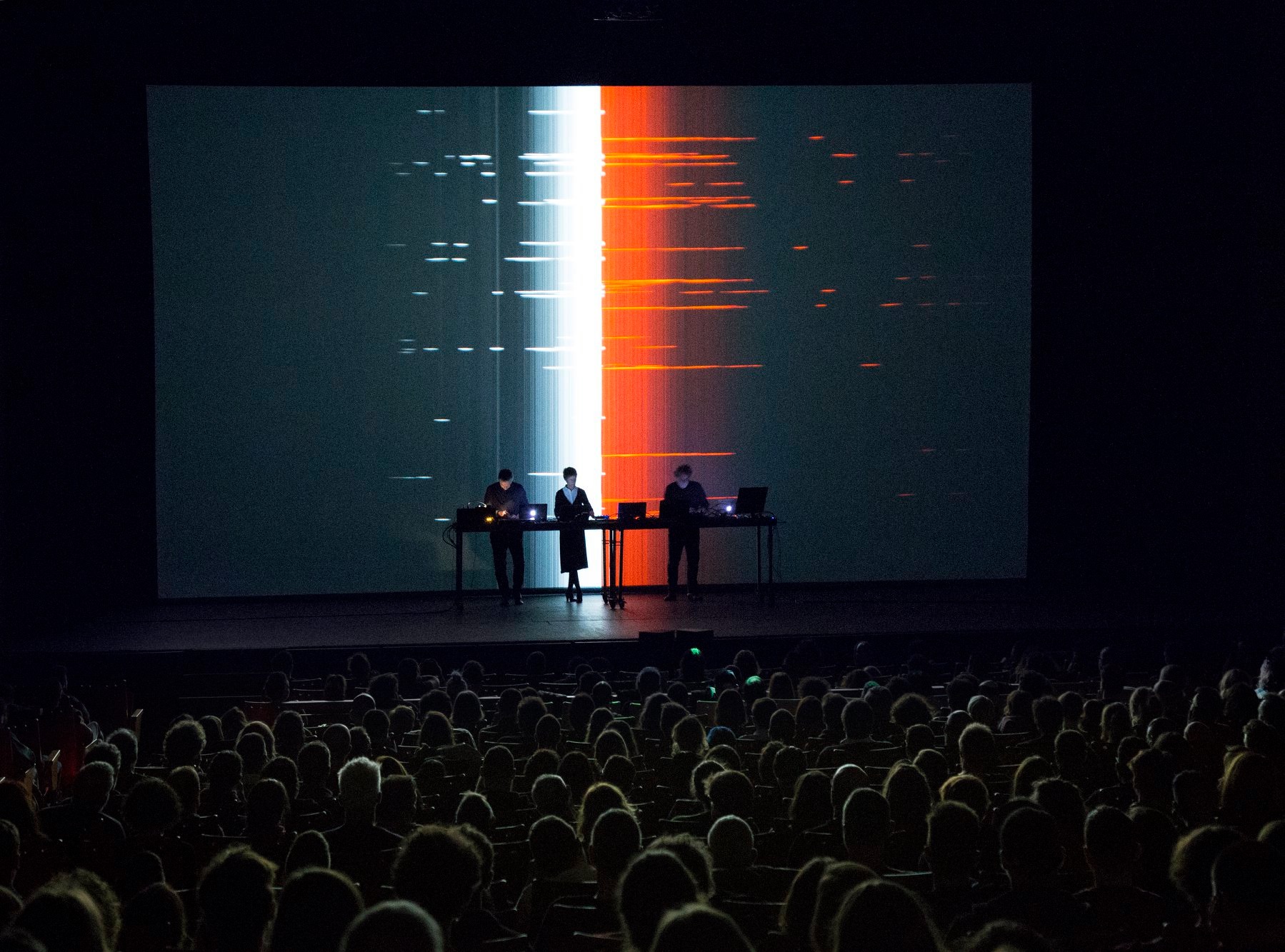

Il 26 agosto 2022 è stato presentato al MUTEK, festival dedicato alla promozione della musica elettronica e delle arti digitali a Montreal, il progetto “Scanaudience”.

E’ stato sviluppato dal duo Schnitt formato da Marco Monfardini e Amelie Duchow in collaborazione con Gianluca Sibaldi.

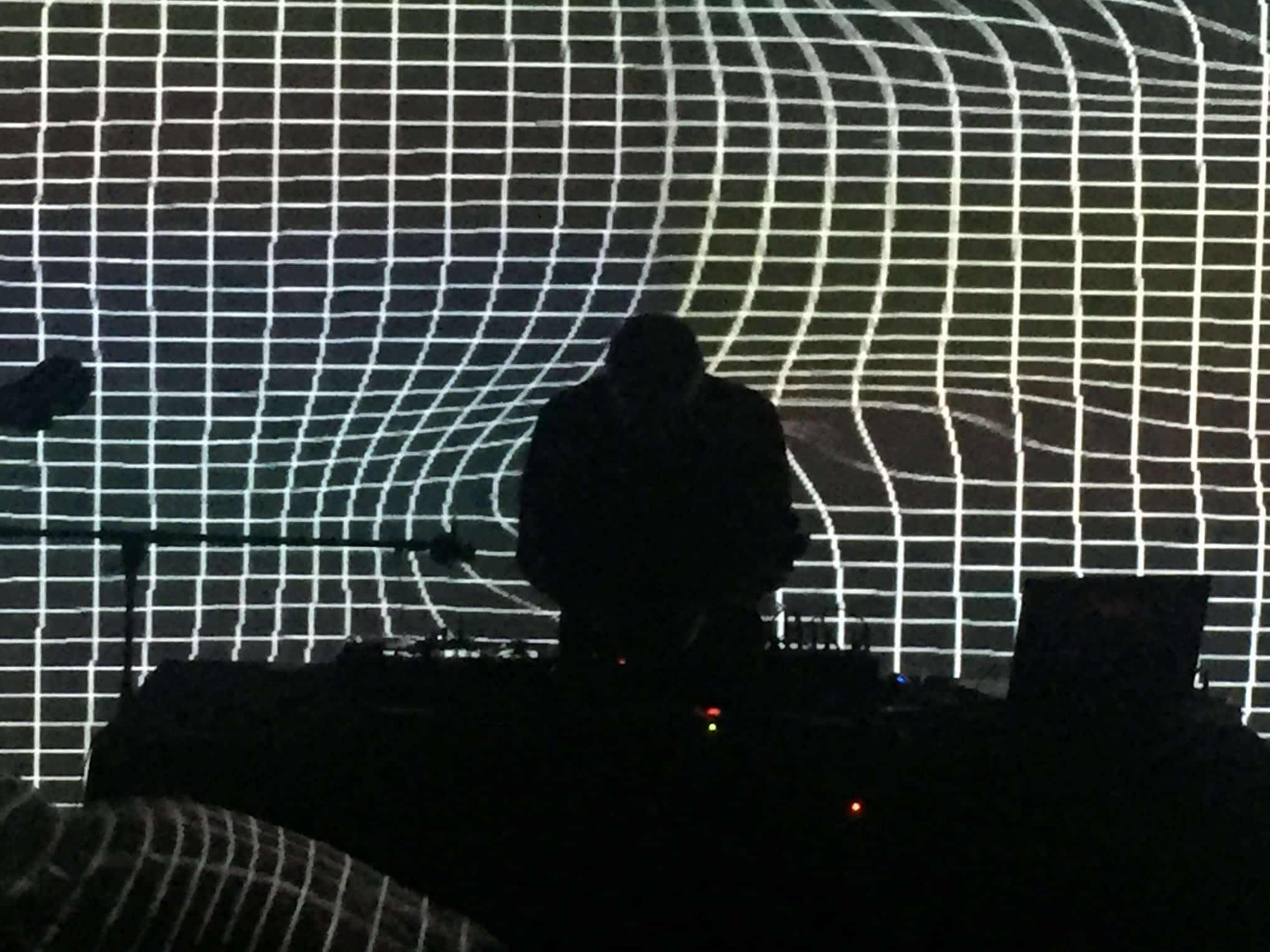

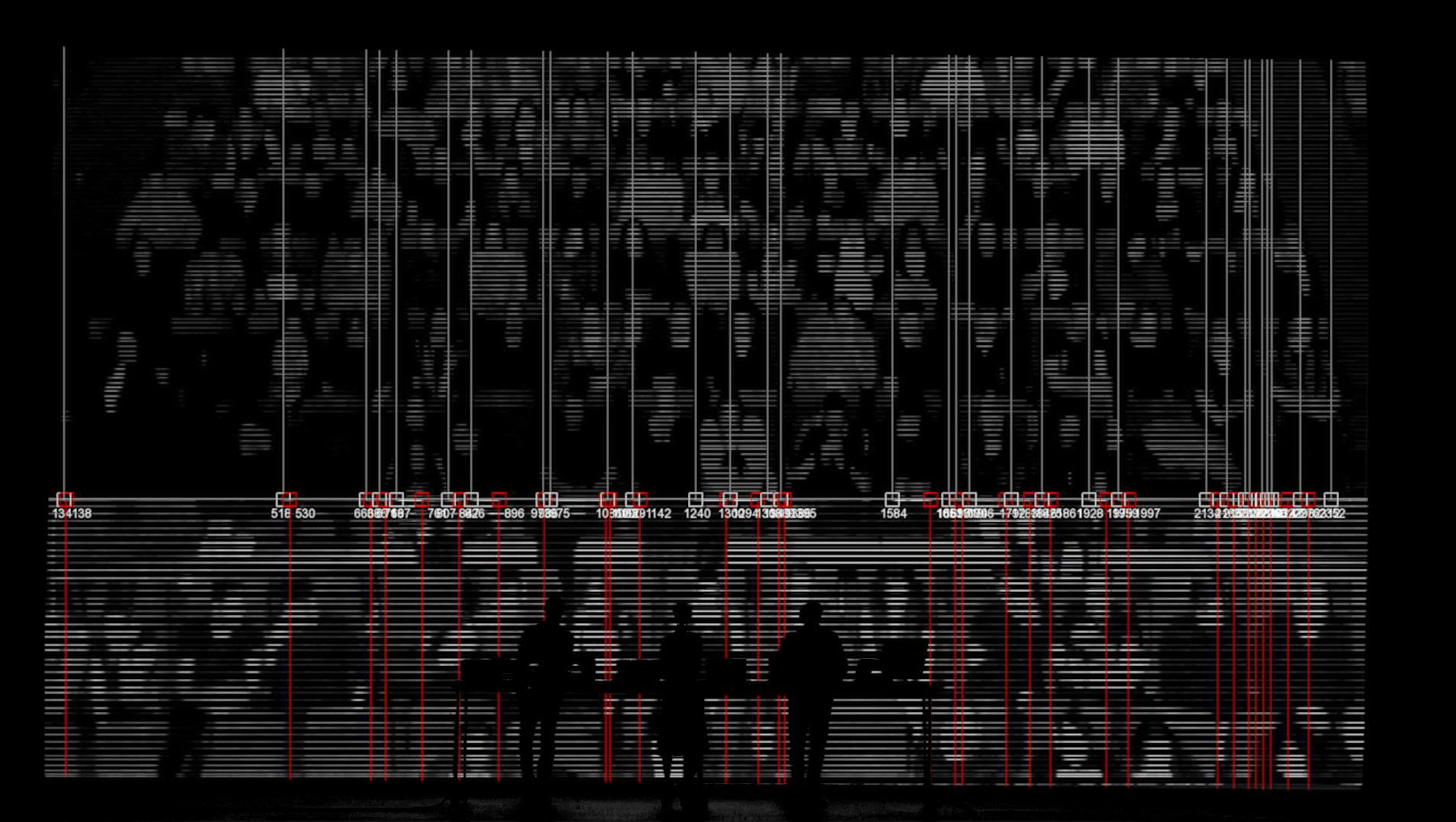

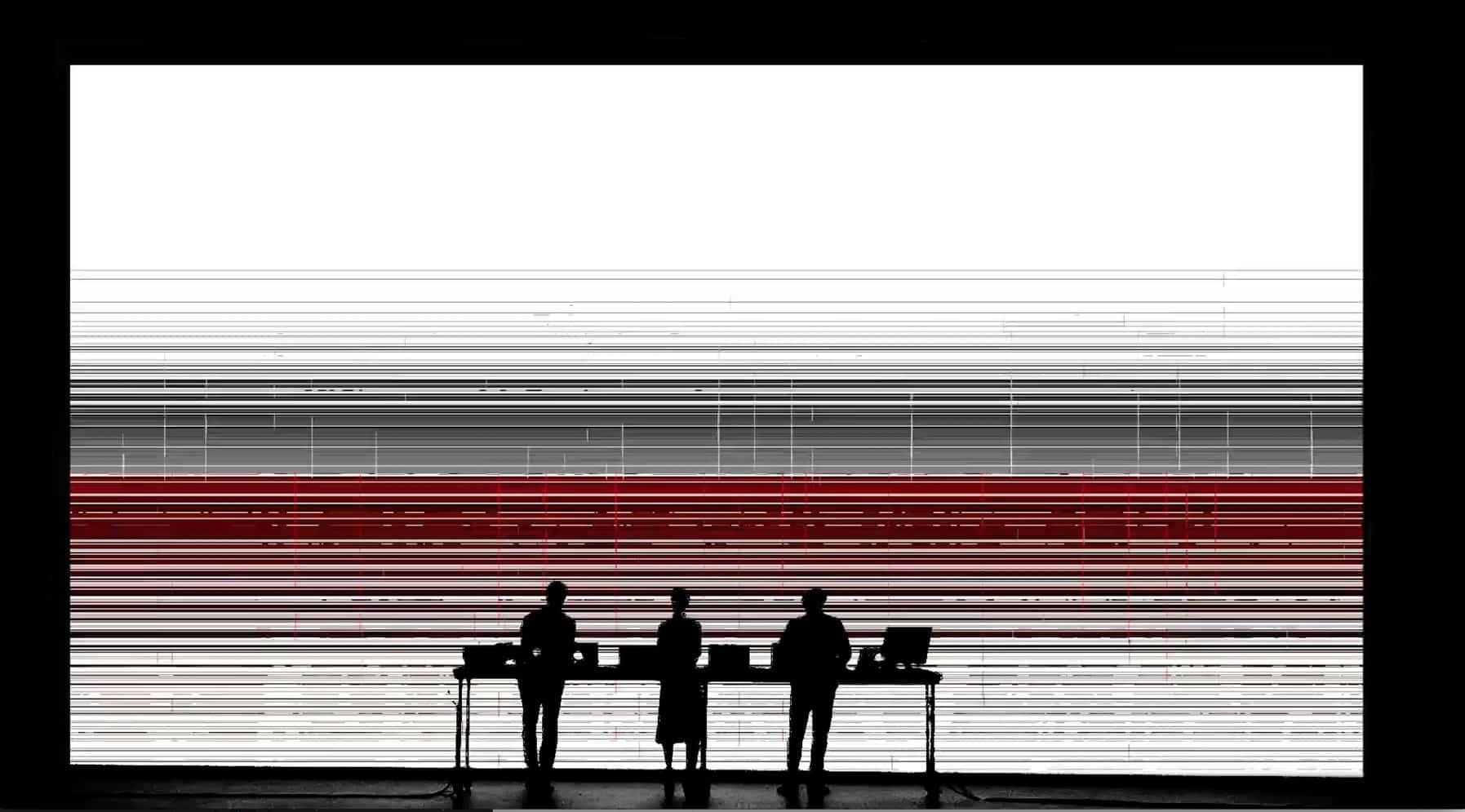

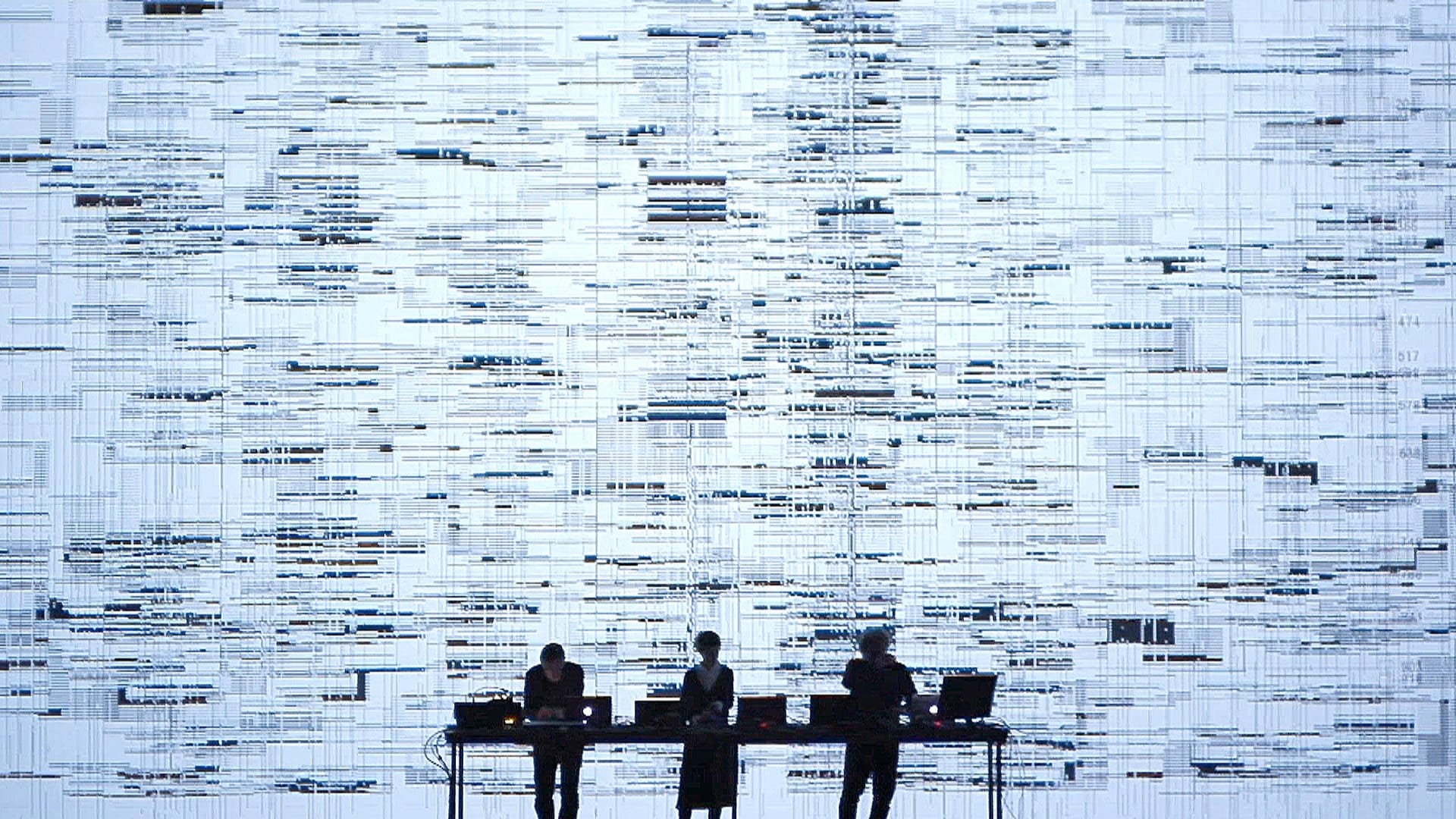

“Scanaudience” è una performance audio e video basata sulla scansione del pubblico in tempo reale, per farlo utilizza un dispositivo elettronico “Extrascan” creato dagli artisti stessi.

Si tratta di uno scanner in grado di “leggere” qualsiasi oggetto, architettura o essere vivente nei suoi elementi formali e tradurli in suono e immagini video.

Una barra luminosa proiettata sul pubblico legge le caratteristiche di ogni singolo spettatore e le trasforma in musica e video.

Così ogni persona che partecipa alla performance genera suoni e immagini e contribuisce allo sviluppo di una nuova dimensione visiva e sonora diventando il vero protagonista.

Ecco la nostra intervista

Ciao! Come nasce il duo Schnitt, quando vi siete conosciuti?

Amelie Duchow: Io sono tedesca di Amburgo e sono a Firenze dal 2003. Ho visto per la prima volta Marco nel 2006 a un concerto che faceva a Firenze. Questo concerto di musica elettronica e video mi è piaciuto moltissimo, mi mancava questa tipologia di suono e immagini in movimento che invece è molto frequente in Germania. Dopo il concerto gli ho fatto i miei complimenti. Successivamente la conoscenza si è evoluta, io ho iniziato a mettere dischi a Firenze e sono entrata nell’etichetta discografica di Marco. Poi è nato il progetto “Schnitt” una collaborazione con il comune interesse per la musica elettronica e la digital art. Tra l’altro il nome Schnitt in tedesco vuol dire taglio, lo abbiamo scelto perchè noi lavoriamo soprattutto tagliando campioni musicali e suoni elettronici.

Marco Monfardini: Per me il nome Schnitt ha anche un doppio significato perchè la nascita di questo progetto ha coinciso per me con un taglio col passato. Avevo necessità di cambiare, dedicarmi a un tipo di ricerca diversa. Volevo aprire una strada nuova e con Amelie è stata l’occasione di confrontarmi con una persona che conoscevo poco e che per me era molto stimolante.

Mi sembra di essere dentro l’ultimo film di Cronenberg “Crimes of The Future” perchè nel vostro progetto “Scanaudience” voi suonate il pubblico, attraverso uno strumento l’ “Extrascan” da voi inventato. Com’è nato e come funziona?

Marco Monfardini: L’Extrascan nasce da una mia idea, da anni avevo in mente di creare uno strumento che attraverso la proiezione di una linea luminosa creata da un normale videoproiettore fosse in grado di leggere le caratteristiche dell’oggetto su cui viene proiettato e trasformare il tutto in audio e video in tempo reale. Ho consultato vari esperti in ambito tecnologico ma nessuno mi ha mai incoraggiato fino a che Gianluca Sibaldi mi ha detto che secondo lui si poteva fare. Da lì abbiamo iniziato a lavorare su questo dispositivo che in realtà è una rete di computer dove ogni computer ha un compito: uno analizza le informazioni, uno le raccoglie e uno le trasforma in audio e video.

Amelie Duchow: In pratica Gianluca è il nostro “creator code” è un compositore ma anche una persona geniale. Lui ha sviluppato un software per gestire la rete dei computer. Il pubblico genera sia la musica che il video.

Quindi in ogni performance voi non sapete che musica suonerete, non esiste uno spartito?

Marco Monfardini: Attraverso la proiezione e il movimento delle linee durante la performance riusciamo a controllare la sonorità e la costruzione. Tutto si muove su una struttura che abbiamo creato in precedenza. La parte inconsapevole è determinata dalla lettura delle persone, la parte prevista da noi è sincronizzata col movimento delle linee. Non c’è uno spartito ma c’è una linea guida sulla quale si innesta il suono che esce dalle persone e dalle loro caratteristiche.

Ma quindi il computer registra le dimensioni, i colori ma anche il movimento delle persone, per esempio se qualcuno si mette a ballare?

Marco Monfardini: Sì, chiaramente il movimento incide soprattutto sul video generando distorsioni.

Voi avete eseguito la performance al Mutek, com’è andata? Come ha reagito il pubblico?

Amelie Duchow: Al Mutek è stata la terza volta che abbiamo realizzato la performance Scanaudience. Nel 2019 c’è stata la prima al LEV Festival in Spagna e qualche anno dopo il progetto è stato presentato alla Philharmonie de Paris per la Biennale Némo 2021. Nelle prime due esecuzioni il pubblico è rimasto immobile, affascinato ma immobile. Al Mutek invece, c’era un pubblico più abituato a vedere performance tecnologiche e sorprendenti e ha interagito molto di più. Ci sono state persone che si baciavano quando passava la linea luminosa oppure muovevano le braccia. Il pubblico ha risposto molto bene.

Dove e quando potremo vedere la performance Scanaudience?

Amelie Duchow: Suoneremo ma non molto vicino alla Toscana. A novembre saremo all‘ACT festival in Corea.